Hace unos días anunciábamos la salida de la segunda versión de Android Wear que, entre otras novedades, trae la opción de enviar respuestas a conversaciones de distintas apps sin llegar a tener que escribir ni dictar nada. Hoy vamos a ver dónde nació esta idea y cómo nuestro dispositivo sabe cuál es la mejor respuesta.

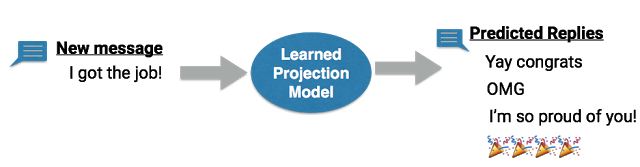

El sistema ha sido desarrollado por el equipo de investigación “Expander” y permite enviar una respuesta que ha sido seleccionada en nuestro propio dispositivo, es decir, es el propio dispositivo quien la busca.

Este sistema permite seleccionar una respuesta dentro de las respuestas que el software da por válidas con un simple toque en la pantalla. De esta forma, contestar o avisar de que hemos llegado a un determinado sitio simplemente consistirá en tocar nuestro reloj.

Los orígenes.

Como desde Google nos indican, la investigación comenzó el año pasado mientras los distintos equipos de Google estaban trabajando en los sistemas de aprendizaje automático de Allo e Inbox.

Como desde Google nos indican, la investigación comenzó el año pasado mientras los distintos equipos de Google estaban trabajando en los sistemas de aprendizaje automático de Allo e Inbox.

El equipo de Android Wear se interesó en estos sistemas pero más tarde se darían cuenta de las limitaciones de hardware que tendrían en algo tan básico como un reloj. Por esta razón y buscando una solución a este nuevo desafío, se le encarga la labor al equipo “Expander”.

Este equipo no tendrá únicamente como tarea buscar una solución al problema de Android Wear, lo que buscará será una nueva solución empezando desde la mesa de dibujo que sea reutilizable en otra serie de casos.

El código.

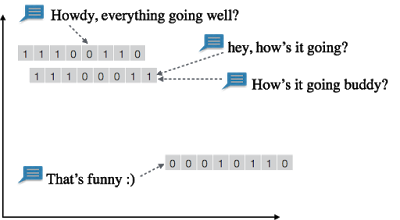

La primera tarea es agrupar frases similares con el objetivo de reducir esta base de datos. Para ello hacen uso de una versión modificada de “Locality Sensitive Hashing” (LSH). De esta forma, frases como “Cómo te va” y “Hola cómo te va”, pueden devolver el mismo resultado, que además supone un tamaño fijo frente a las posibilidades enormes a la hora de hacer una oración.

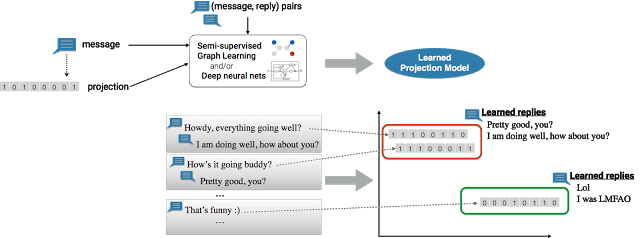

Lo siguiente es aplicar este sistema a una serie de posibles frases con sus respectivas respuestas. Haciendo esto, se crea un “Modelo de proyección” que nos permitirá deducir las respuestas en determinados casos.

Hay que señalar que estos modelos de proyección son creados con un hardware más complejo puesto que se trata de tareas complejas que necesitan muchos más recursos. No obstante, este modelo pasará a ser usado directamente en el dispositivo.

Un ejemplo, en el mundo de las matemáticas sería relacionar el modelo de proyección con una determinada función matemática compleja cuya elaboración nos lleve un par de días, mientras que en el dispositivo simplemente aplicaremos valores para conseguir un resultado de forma casi inmediata.

Lo que han conseguido.

Los propios creadores de este sistema se muestran sorprendidos del propio funcionamiento de esta herramienta, que recordemos que está abierta a terceros, contando también con una API. De todas formas, también anuncian próximas mejoras del sistema por lo que tendremos que esperar a ver que son capaces de lograr.

Vía – Google.