En el siempre cambiante mundo del desarrollo de aplicaciones, la eficiencia y la calidad son reinas. Conscientes de ello, desde Android Developer, nos llega una noticia que promete revolucionar la forma en que los desarrolladores de Android interactúan con la inteligencia artificial. Google acaba de presentar Android Bench, una iniciativa que busca ser la brújula en el vasto océano de los Modelos de Lenguaje Grandes (LLMs) aplicados al desarrollo de apps para nuestro sistema operativo. Prepárense, porque la IA está a punto de entender Android como nunca antes.

¿Qué es Android Bench y por qué es un antes y un después?

Imaginad tener una IA que no solo os entiende, sino que también comprende las particularidades y los quebraderos de cabeza específicos de la plataforma Android. Ese es precisamente el objetivo de Android Bench. No es solo un sistema de puntuación; es un estándar creado para medir cómo de bien rinden los distintos LLMs en tareas de desarrollo Android.

Más allá de la teoría: Impacto real en la productividad

El propósito principal es claro: agilizar y simplificar la creación de aplicaciones Android de alta calidad. Al ofrecer una referencia fiable para evaluar las capacidades de los LLMs, Google no solo ayuda a los creadores de modelos a identificar dónde mejorar, sino que también empodera a los desarrolladores.

Con una IA más fina y precisa, podremos trabajar de forma más eficiente y elegir entre una gama más amplia de herramientas de asistencia impulsadas por IA, lo que, a la larga, se traducirá en apps mejores para todo el ecosistema Android.

Un diseño que se enfrenta a la realidad del desarrollo Android

Una de las claves de Android Bench reside en su metodología. Lejos de pruebas genéricas, este benchmark se ha construido a partir de un conjunto de tareas cuidadosamente seleccionadas que replican desafíos reales del día a día de un desarrollador.

Estas tareas provienen de repositorios públicos de Android en GitHub y varían en dificultad y tipo:

- Resolución de cambios que rompen la compatibilidad entre distintas versiones de Android.

- Tareas muy específicas de dominio, como la gestión de redes en dispositivos wearables.

- Migración a las últimas versiones de herramientas clave como Jetpack Compose.

Cada evaluación consiste en que un LLM intente solucionar un problema reportado en una tarea, y luego se verifica la solución mediante tests unitarios o de instrumentación. Este enfoque, que no depende del modelo específico, permite medir la capacidad de la IA para navegar por bases de código complejas, entender dependencias y resolver esos problemas que los desarrolladores se encuentran a diario.

La robustez de esta metodología no ha pasado desapercibida. Grandes nombres del sector, como JetBrains, han validado el planteamiento, destacando su realismo y la necesidad de una evaluación tan rigurosa en el panorama actual.

Los primeros resultados: ¿Quién lidera la carrera de la IA en Android?

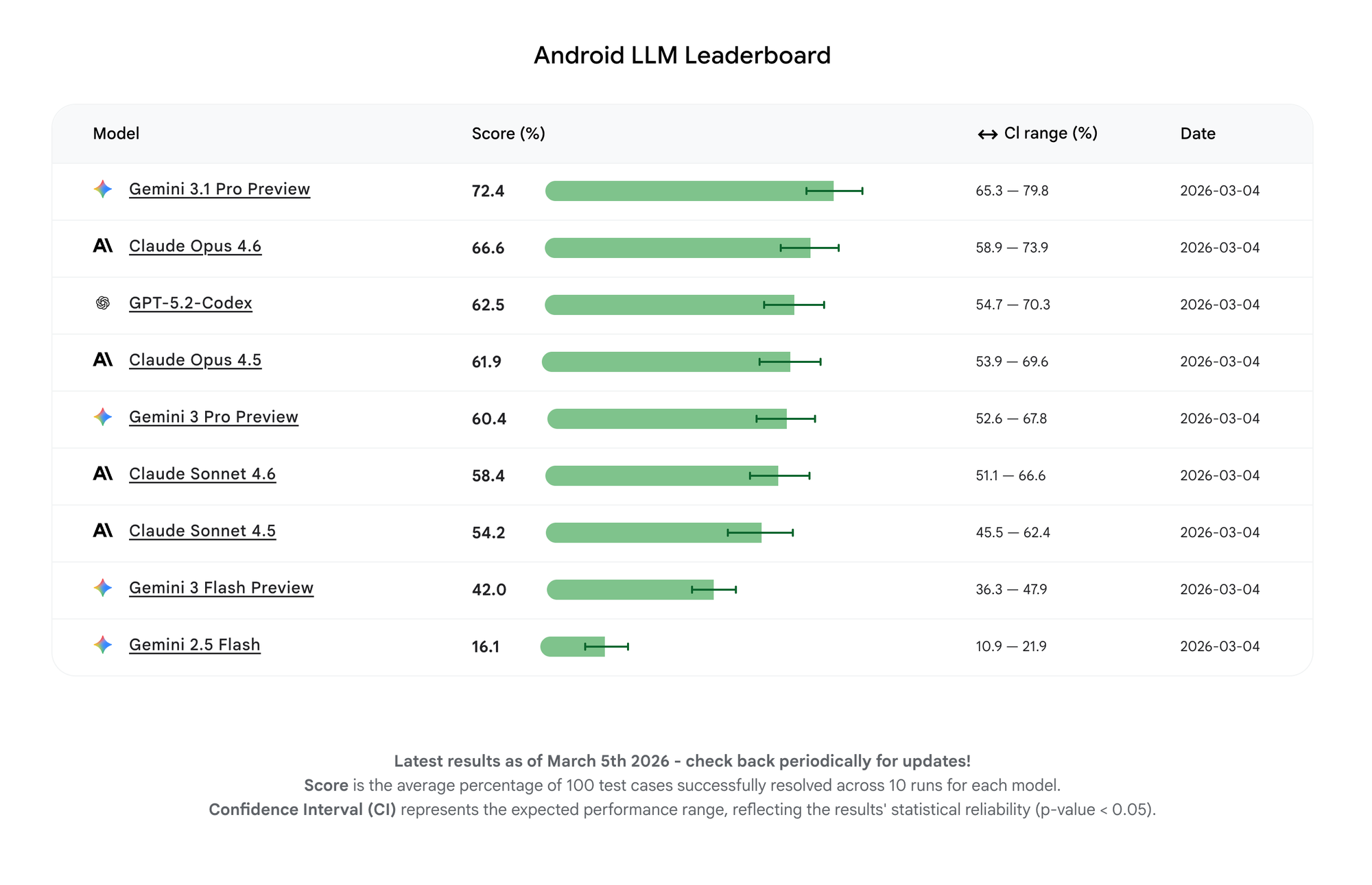

En esta primera entrega, el enfoque ha sido puramente en el rendimiento del modelo, sin considerar el uso de agentes o herramientas adicionales. Los resultados iniciales muestran una horquilla amplia, con modelos capaces de completar entre el 16% y el 72% de las tareas. Esto deja claro que, mientras algunos LLMs ya cuentan con una base sólida de conocimiento Android, otros tienen un margen considerable para mejorar.

El podio inicial

El LLM con la puntuación media más alta en este primer lanzamiento es Gemini 3.1 Pro, seguido de cerca por Claude Opus 4.6. ¡Buenas noticias! Ya podéis probar estos modelos para la asistencia de IA en vuestros proyectos Android utilizando claves API en la última versión estable de Android Studio.

Desde Google esperan y animan a los creadores de LLMs a seguir mejorando sus modelos específicos para el desarrollo Android, anticipando una evolución constante y positiva.

Transparencia y futuro de la evaluación de IA en Android

Un pilar fundamental de Android Bench es la transparencia. Tanto la metodología utilizada, como el conjunto de datos y el sistema de pruebas, se han hecho públicos en GitHub. Esto permite que la comunidad pueda auditar y contribuir, fomentando un ecosistema de desarrollo abierto.

Retos y evolución

Como cualquier benchmark público, existe el riesgo de "contaminación de datos" (que los modelos ya hayan visto las tareas de evaluación durante su entrenamiento). Para combatirlo, se han implementado medidas rigurosas, incluyendo revisiones manuales exhaustivas y la integración de una cadena "canario" para disuadir el entrenamiento. De cara al futuro, Google promete seguir evolucionando la metodología para preservar la integridad de los datos, así como aumentar la cantidad y complejidad de las tareas.

La visión a largo plazo es emocionante: cerrar la brecha entre una idea y un código de calidad. Están sentando las bases para un futuro donde, sin importar lo que imaginemos, podamos construirlo en Android con la ayuda inteligente que necesitamos.