Prepárense, usuarios y desarrolladores, porque la forma en que interactuamos con nuestros móviles está a punto de dar un vuelco. Google ha desvelado importantes avances que buscan transformar Android en un ecosistema mucho más conectado con la inteligencia artificial, permitiendo que asistentes como Gemini hagan el trabajo pesado por nosotros. Olvídate de abrir y cerrar apps para cada tarea; la nueva era es sobre la eficiencia y la integración profunda de la IA.

AppFunctions: cuando tus apps conversan con la IA

Imagina que puedes pedirle a tu asistente de IA que te muestre algo de una app específica sin siquiera abrirla. Pues bien, esto ya es una realidad gracias a AppFunctions, una nueva capacidad que permite a las aplicaciones Android exponer su funcionalidad y sus datos directamente a agentes y asistentes de IA. ¿El secreto? Una combinación de la librería Jetpack y APIs de plataforma que permiten a los desarrolladores crear funciones "autodescriptivas". Estas funciones pueden ser descubiertas y ejecutadas por la IA mediante lenguaje natural.

A diferencia de soluciones que dependen de servidores en la nube, AppFunctions está diseñado para ejecutarse localmente en el dispositivo. Esto no solo mejora la privacidad y seguridad, sino que también agiliza la experiencia del usuario.

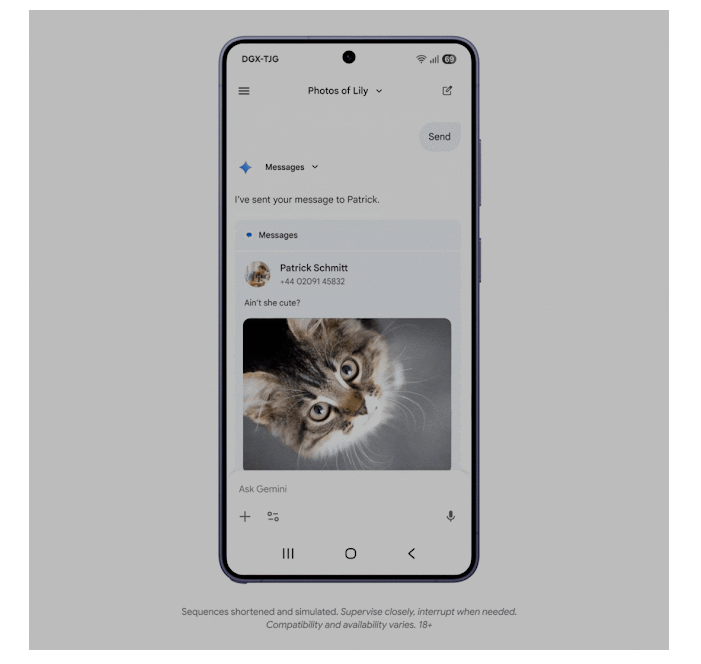

Un ejemplo práctico con la serie Galaxy S26

La integración de la Galería de Samsung con Gemini en los recién lanzados Galaxy S26 es un escaparate perfecto. En lugar de navegar manualmente por tus álbumes, ahora puedes simplemente pedir a Gemini: "Muéstrame fotos de mi gato de la Galería de Samsung". Gemini, de forma inteligente, identifica y activa la función adecuada y te presenta las fotos directamente dentro de su propia interfaz, sin necesidad de salir de la app de Gemini. Además, esta interacción es multimodal, lo que significa que puedes usar tanto la voz como el texto, e incluso utilizar esas fotos en conversaciones posteriores, como enviarlas a amigos por mensaje.

Esta capacidad, aunque debutó en la serie Galaxy S26, pronto se extenderá a otros dispositivos Samsung con OneUI 8.5 o superior. Además, Gemini ya está utilizando AppFunctions para automatizar tareas en categorías como Calendario, Notas y Tareas, incluso en dispositivos de otros fabricantes, optimizando la gestión diaria de los usuarios.

Automatización inteligente de la interfaz: IA para todos, sin código

Sabemos que no todas las interacciones tienen una integración específica a través de AppFunctions, y ahí es donde entra en juego la segunda gran novedad: un marco de automatización inteligente de la interfaz de usuario. Esta funcionalidad permite a los agentes de IA ejecutar tareas genéricas en las aplicaciones instaladas por los usuarios, y lo mejor de todo es que, para los desarrolladores, esto significa una mayor visibilidad sin necesidad de escribir una sola línea de código.

Es el propio sistema el que hace el trabajo pesado, extendiendo el alcance agentivo a un abanico mucho más amplio de aplicaciones de forma sencilla. Por supuesto, la transparencia y el control del usuario son pilares fundamentales de este sistema.

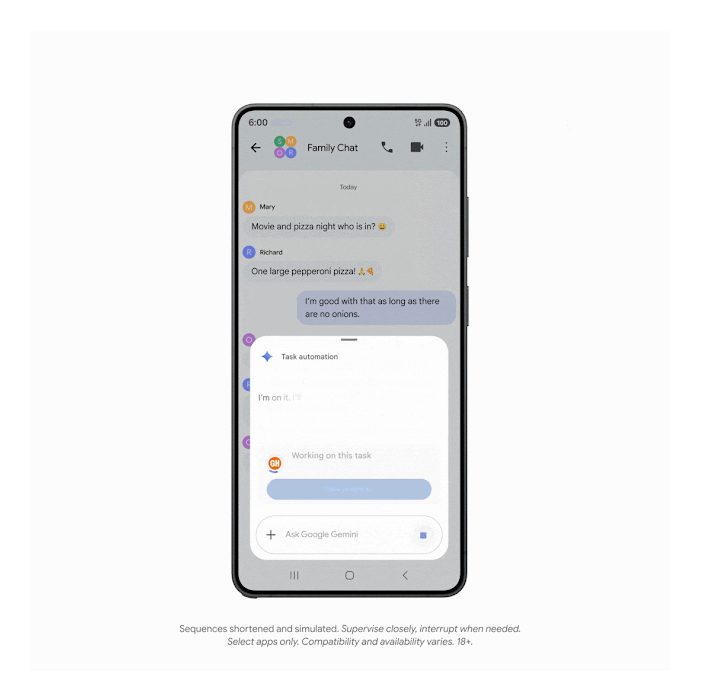

Delegando tareas complejas con un toque

Esta función ya está en una fase de prueba inicial en la serie Galaxy S26 y en algunos dispositivos Pixel 10. Los usuarios pueden delegar tareas con múltiples pasos a Gemini simplemente manteniendo pulsado el botón de encendido. Lanzada como una función beta dentro de la app de Gemini, esta automatización comenzará dando soporte a una selección de aplicaciones de reparto de comida, supermercados y transporte compartido, inicialmente en EE. UU. y Corea.

¿Necesitas pedir una pizza compleja para toda la familia con sus gustos particulares? ¿Coordinar un viaje con varias paradas con tus compañeros? ¿O simplemente volver a pedir tu última compra del supermercado? Gemini puede echarte una mano, utilizando el contexto de tus apps sin que los desarrolladores necesiten hacer nada.

La clave aquí es que el usuario siempre tiene el control. Mientras una tarea se ejecuta en segundo plano, se puede monitorizar su progreso a través de notificaciones o una "vista en vivo", y si en algún momento deseas tomar el control manual, puedes hacerlo. Además, Gemini está diseñado para alertar a los usuarios antes de completar tareas sensibles, como una compra.

El futuro de la interacción móvil ya está aquí

Este es solo el comienzo. Google ha anunciado que en Android 17, que llegará más adelante este año, buscarán ampliar estas capacidades para alcanzar a más usuarios, desarrolladores y fabricantes de dispositivos. Actualmente, están colaborando con un grupo selecto de desarrolladores para asegurar experiencias de usuario de alta calidad a medida que el ecosistema evoluciona.

Si eres desarrollador, mantente atento, porque se espera que Google comparta más detalles sobre cómo integrar AppFunctions y la automatización de la interfaz en tus propias aplicaciones más adelante en este 2026. La era de las aplicaciones que no solo te esperan, sino que anticipan y ejecutan tus necesidades, ha llegado para quedarse.